반갑습니다, 여러분. 이번엔 교육통계학의 ‘꽃’이라 불리는 구조방정식 모델링(SEM)을 공부하다 보면 한 번쯤 마주하게 되는 현실적인 고민, 바로 “표본 크기가 작을 때 어떻게 해야 하는가?”와 “요인 점수(Factor Scores)를 그냥 회귀분석에 써도 되는가?”에 대해 심도 있게 다뤄보겠습니다.

우리는 보통 SEM이 잠재 변수 간의 관계를 파악하는 가장 완벽한 도구라고 배웁니다. 하지만 실제 교육 현장에서 데이터를 수집하다 보면 표본 200~300명을 모으는 것이 하늘의 별 따기처럼 느껴질 때가 많죠. 이럴 때 대안으로 제시되는 요인 점수 회귀분석(FSR)과 그 편향을 획기적으로 해결한 Croon 방법(SAM 접근법)에 대해 자세히 살펴보겠습니다.

1. 구조방정식(SEM)의 명암: 왜 대안이 필요한가?

SEM은 잠재 변수를 다룰 때 측정 오차(Measurement Error)를 통계적으로 고려하기 때문에 비편향된(Unbiased) 추정치를 얻을 수 있다는 강력한 장점이 있습니다. 또한 모델이 데이터에 얼마나 잘 맞는지 다양한 적합도 지수를 통해 확인할 수 있죠.

하지만 현실적인 제약이 따릅니다.

- 대표본의 필요성: 추정해야 할 파라미터가 많아질수록 아주 큰 표본 크기가 필요합니다. 예산이나 시간 제약이 큰 학교 현장 연구에서는 이를 충족하기 어렵습니다.

- 오차의 전이: 모델의 어느 한 부분만 잘못 설정(Misspecification)되어도 모델 전체의 파라미터가 왜곡될 위험이 있습니다.

이런 이유로 연구자들은 잠재 변수 대신 요인 점수(Factor Scores)를 계산하여 일반적인 회귀분석을 돌리는 방식을 택하곤 합니다. 이것이 바로 요인 점수 회귀분석(FSR)입니다.

2. 요인 점수 활용의 함정: “나이브(Naive)한 접근의 위험성”

많은 연구자가 단순히 요인 분석으로 점수를 뽑아 회귀분석을 수행하지만, 이는 편향된 결과를 낳을 확률이 매우 높습니다.

왜 편향이 발생하는가?

요인 점수 는 관측 변수들의 선형 결합으로 계산되는데, 이 과정에서 측정 오차가 완전히 제거되지 않고 점수에 포함됩니다. 결과적으로 요인 점수의 분산-공분산 행렬()은 실제 잠재 변수의 그것()과 달라지게 되며, 이를 바탕으로 계산된 회귀 계수는 대개 과소 추정(Downward bias)되거나 왜곡됩니다.

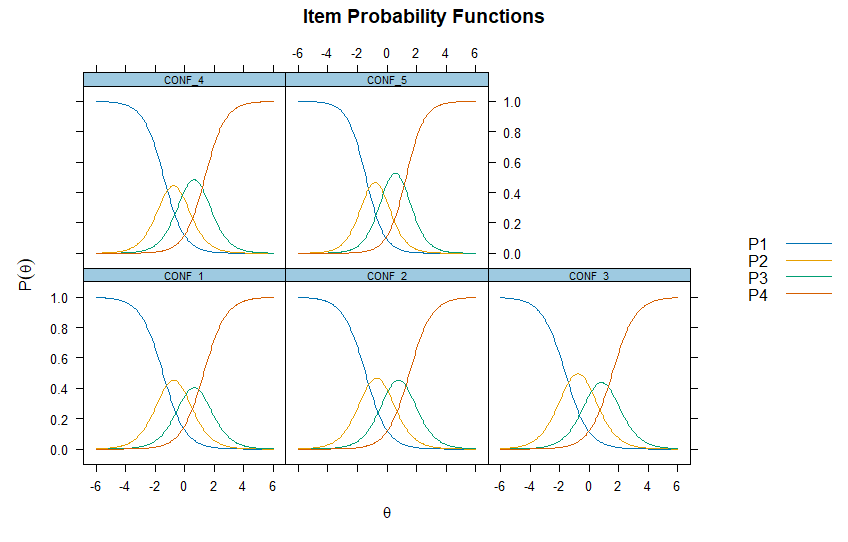

요인 점수 산출 방식에 따른 차이

| 방법 | 설명 | 결과의 특성 |

| Regression Predictor () | Thomson, Thurstone이 제안 | 독립 변수만 잠재 변수일 때 비편향 |

| Bartlett Predictor () | Bartlett이 제안 | 종속 변수만 잠재 변수일 때 비편향 |

| 합산 점수 (Sum Scores) | 단순히 문항 점수를 더함 | 병행 측정 모델(Parallel Model) 가정이 깨지면 큰 편향 발생 |

3. 해결사: Croon 방법과 SAM (Structural After Measurement)

이런 편향 문제를 해결하기 위해 Croon(2002)은 요인 점수의 분산-공분산 행렬을 수학적으로 보정하는 공식을 제안했습니다.

Croon의 보정 공식

잠재 변수의 실제 분산과 공분산을 추정하기 위해 다음과 같은 행렬 연산을 수행합니다.

이 방법은 먼저 측정 모델을 개별적으로 추정한 뒤(Step 1), 그 정보를 바탕으로 구조 모델을 추정하는(Step 2) 2단계 접근법의 일종입니다. 최근에는 이를 SAM(Structural After Measurement)이라는 더 넓은 프레임워크로 부르기도 합니다.

4. 실전 사례: 학교급별 디지털 리터러시와 학습 참여도

이해를 돕기 위해 교육 현장의 가상 시나리오를 만들어 보았습니다.

[가상 시나리오: 디지털 선도학교 연구]

A 교수는 초등학교 50개교의 교장 선생님을 대상으로 ‘학교의 디지털 인프라 수준’이 ‘교사의 디지털 교수 역량’을 매개로 ‘학생의 학습 참여도’에 미치는 영향을 연구하고자 합니다. 하지만 관측 변수는 40개가 넘는데 표본(교장단)은 50명뿐입니다. 일반적인 SEM으로는 추정이 불가능한 상황입니다.

모의 데이터 생성 및 분석 (R 기반)

jamovi의 기본 SEM 모듈은 표준적인 SEM 위주이므로, SAM(Croon 방법)을 정확히 구현하기 위해 jamovi 내부의 Rj Editor를 사용하거나 R을 활용하는 것이 좋습니다.

R

# 필요한 라이브러리 로드

library(lavaan)

# 1. 가상 데이터 생성 (N=50, 소표본 상황)

set.seed(2025)

model_pop <- '

Infrastructure =~ 0.8*i1 + 0.7*i2 + 0.9*i3

Competency =~ 0.8*c1 + 0.7*c2 + 0.6*c3

Engagement =~ 0.9*e1 + 0.8*e2 + 0.7*e3

Competency ~ 0.5*Infrastructure

Engagement ~ 0.4*Competency

'

data_school <- simulateData(model_pop, sample.nobs = 50)

# 2. 일반 SEM 시도 (표본이 작아 수렴 실패나 불안정한 결과 가능성)

fit_sem <- sem(model_pop, data = data_school)

# 3. SAM (Croon 방법 적용) 분석

# local SAM은 Croon의 보정법과 수학적으로 동일함 [cite: 409]

fit_sam <- sam(model_pop, data = data_school, sam.method = "local")

# 결과 비교 출력

summary(fit_sam)

분석 결과 해석

- 일반 SEM: 표본 크기()에 비해 파라미터가 너무 많아 적합도 지수가 신뢰하기 어렵거나 추정치가 불안정할 수 있습니다.

- SAM(Croon 방법): 측정 모델을 먼저 블록별로 분리해서 추정하므로 소표본에서도 안정적으로 수렴하며, 요인 점수 사용 시 발생하는 편향을 보정하여 비편향된 경로 계수를 산출합니다.

5. 요약 및 결론

연구자로서 우리는 언제나 ‘완벽한’ SEM을 꿈꾸지만, 현장은 늘 우리에게 ‘작은 표본’이라는 과제를 던져줍니다.

- 나이브한 요인 점수 사용은 금물: 측정 오차로 인해 결과가 왜곡됩니다.

- 소표본이나 복잡한 모델에는 SAM(Croon)이 대안: 모델을 부분적으로 나누어 추정하므로 강건(Robust)하며, 오차 전이 문제를 방지할 수 있습니다.

- 도구 활용: R의

lavaan패키지에 있는sam()함수를 활용하면 전문가 수준의 보정된 분석이 가능합니다.

교육학 연구의 가치는 데이터의 양보다 그 해석의 정교함에 있습니다. Croon 방법을 통해 작은 데이터에서도 빛나는 통찰을 얻으시길 바랍니다.

참고문헌

- Croon, M. A. (2002). Using predicted latent scores in general latent structure models. In G. Marcoulides & I. Moustaki (Eds.), Latent variable and latent structure modeling (pp. 195–223). Erblbaum.

- Devlieger, I., Mayer, A., & Rosseel, Y. (2016). Hypothesis testing using factor score regression: A comparison of four methods. Educational and Psychological Measurement, 76(5), 741–770.

- Devlieger, I., & Rosseel, Y. (2017). Factor score path analysis: An alternative for SEM? Methodology, 13, 31–38.

- Devlieger, I., Talloen, W., & Rosseel, Y. (2019). New developments in factor score regression: Fit indices and a model comparison test. Educational and Psychological Measurement, 79(6), 1017–1037.

- Rosseel, Y., & Loh, W. W. (in press). A structural-after-measurement (SAM) approach to structural equation modeling. Psychological Methods.