안녕하세요?

이번에는 현대 교육 연구에서 개인의 변화를 추적하고 분석하는 가장 강력한 도구 중 하나인 잠재곡선 모델링(Latent Curve Modeling, LCM)에 대해 깊이 있게 다뤄보겠습니다.

종단적 성장 데이터(Longitudinal growth data)는 동일한 대상을 반복 측정하고, 동일한 척도를 사용하며, 관찰 시점을 정확히 알고 있다는 독특한 특징이 있습니다. 이러한 특징은 교육 현장에서 학생의 성취도 변화나 심리적 발달을 이해하는 데 엄청난 기회를 제공합니다.

이 글은 여러분이 jamovi(또는 R)를 활용해 직접 분석을 수행할 수 있도록 이론부터 실무까지 상세히 안내할 것입니다.

1. 잠재곡선 모델의 기초: 변화를 어떻게 정의할 것인가?

잠재곡선 모델의 핵심 아이디어는 각 개인의 반복 측정된 점수를 ‘개인별 궤적(Individual Trajectory)’으로 이해하는 것입니다. 이는 고전적인 분산 분석(ANOVA)이 집단 평균의 변화에 집중했던 것과 대조적입니다.

1.1 기본 방정식

가장 고전적인 잠재곡선 모델은 반복 측정된 관찰 점수()를 세 가지 성분으로 분해합니다.

- 잠재 절편(): 개인 의 초기 수준 또는 기준점 점수입니다.

- 잠재 기울기(): 시간 경과에 따른 개인 의 변화량(성장률)입니다.

- 잔차(): 특정 측정 시점 에서 발생하는 오차나 고유한 특징입니다.

여기서 기저 계수(, Basis coefficients)는 변화의 형태를 결정합니다. 예를 들어, 4년간 매년 측정했다면 를 [0, 1, 2, 3]으로 고정하여 선형 성장을 가정할 수 있습니다.

2. 분석 프레임워크: SEM vs. MLM

성장 모델은 다층 모델(MLM)이나 구조방정식 모델(SEM) 프레임워크 모두에서 추정 가능하지만, 각각 장단점이 있습니다.

| 특징 | MLM (Multilevel Modeling) | SEM (Structural Equation Modeling) |

| 주요 장점 | 비선형 궤적 직접 추정 가능, 소표본에 유리(REML 사용) | 복잡한 통계 모델의 일부로 포함 가능(예: 2차 요인 모델) |

| 유연성 | 시점 간 잔차 구조 제약적 | 다양한 잔차 구조 설정 가능, 적합도 지수 제공 |

본 내용에서는 모형의 적합도를 평가하고 더 복잡한 인과 관계를 확장하기에 유리한 SEM 접근법에 초점을 맞춥니다.

3. [사례 연구] 초등학생의 어휘력 성장 분석

이론을 실생활에 적용해 봅시다. 한 초등학교에서 1학년부터 4학년까지 동일한 학생 100명을 대상으로 매년 ‘어휘력 검사(Vocabulary Test)’를 실시했다고 가정합시다.

3.1 모의 데이터 생성 배경 (Story)

- 연구 질문: 학생들의 어휘력은 학년이 올라감에 따라 선형적으로 발달하는가? 초기 어휘력 수준이 높은 학생이 더 빠르게 성장하는가?

- 데이터 구성:

Student_ID,Grade1,Grade2,Grade3,Grade4,Family_SES(가족 사회경제적 지위).

3.2 jamovi/R 분석 가이드

jamovi의 SEMLj 모듈이나 R의 lavaan 패키지를 사용하여 분석을 수행할 수 있습니다.

R을 활용한 선형 성장 모델링 예시 코드:

R

# 1. 필요한 패키지 로드

if(!require(lavaan)) install.packages("lavaan")

library(lavaan)

# 2. 교육현장 모의 데이터 생성 (100명의 학생)

set.seed(2026) # 결과 재현을 위한 설정

n <- 100

# 가상 요인 생성

SES <- rnorm(n, 0, 1) # 사회경제적 지위 (표준화 점수)

intercept <- 50 + 5 * SES + rnorm(n, 0, 2) # 초기치 (SES 영향 포함)

slope <- 3 + 1.5 * SES + rnorm(n, 0, 0.5) # 성장률 (SES 영향 포함)

# 4개 시점 데이터 생성 (선형 성장 가정)

Grade1 <- intercept + rnorm(n, 0, 1)

Grade2 <- intercept + 1 * slope + rnorm(n, 0, 1)

Grade3 <- intercept + 2 * slope + rnorm(n, 0, 1)

Grade4 <- intercept + 3 * slope + rnorm(n, 0, 1)

# 데이터프레임 구축

vocab_data <- data.frame(Grade1, Grade2, Grade3, Grade4, SES)

# 3. 잠재곡선 모델(LCM) 정의

# i(intercept)와 s(slope)를 정의하고 기저 계수를 [0, 1, 2, 3]으로 고정합니다.

lcm_model <- '

i =~ 1*Grade1 + 1*Grade2 + 1*Grade3 + 1*Grade4

s =~ 0*Grade1 + 1*Grade2 + 2*Grade3 + 3*Grade4

# 조건부 모델: SES가 i와 s를 예측

i ~ SES

s ~ SES

'

# 4. 모델 추정 및 결과 보고

fit <- growth(lcm_model, data = vocab_data)

summary(fit, fit.measure = TRUE, standardized = TRUE)3.3 결과 해석 가이드

분석 결과에서 여러분이 주목해야 할 핵심 파라미터는 다음과 같습니다.

1) 고정 효과 (Fixed Effects)

i ~ 1(절편 평균): 우리 학교 1학년 학생들의 평균 어휘력 점수입니다.s ~ 1(기울기 평균): 학생들이 매년 평균적으로 몇 점씩 성장했는지를 나타냅니다.

2) 랜덤 효과 (Random Effects / Variances)

i ~~ i(절편 분산): 학생들 간의 초기 어휘력 차이가 얼마나 큰지 보여줍니다.s ~~ s(기울기 분산): 학생마다 성장 속도가 얼마나 다른지(개별성)를 나타냅니다.

3) 예측 요인 해석 (Regression Paths)

s ~ SES: 이 값이 통계적으로 유의한 양수라면, “가정의 사회경제적 지위가 높을수록 어휘력 성장 속도가 더 빠르다”는 교육적 결론을 내릴 수 있습니다.

4. jamovi에서 수행하는 방법

R 코드가 익숙하지 않다면, jamovi의 SEMLj 모듈을 사용해 보세요.

- 데이터 준비: 위 R 스크립트로 생성한

vocab_data를 CSV로 저장하여 jamovi에서 엽니다. - 모듈 실행:

SEMLj->Syntax Mode또는Growth Model클릭. - 변수 배치:

Grade1~4를 각 시점(Time points)에 배치합니다. - 기저 계수 설정: 학년별로 [0, 1, 2, 3]을 직접 입력하여 선형 모델을 구성합니다.

- 예측 변수:

SES를Covariates칸에 넣어 성장에 미치는 영향을 확인합니다.

5. 모델의 단계적 확장과 해석

분석은 보통 간단한 모델에서 시작하여 점진적으로 매개변수를 추가합니다.

5.1 무변화 모델 (Level-only Model)

성장이 없다고 가정하는 모델입니다. 만약 이 모델의 적합도가 나쁘다면(보통 나쁩니다), 이는 학생들의 점수가 시간에 따라 변화했음을 의미합니다.

5.2 선형 성장 모델 (Linear Growth Model)

매년 일정한 속도로 성장한다고 가정합니다.

- 평균(): 전체 학생의 평균적인 연간 성장률입니다.

- 변량(): 학생들 간에 성장 속도 차이가 얼마나 큰지 보여줍니다.

- 공분산(): 초기 수준(절편)과 성장률(기울기) 사이의 관계입니다. 교육적으로는 종종 초기값이 낮은 학생이 더 빨리 성장하는지(보상 효과)를 확인하는 데 쓰입니다.

5.3 잠재 기저 모델 (Latent Basis Model)

변화의 형태를 데이터가 스스로 결정하게 하는 모델입니다. 첫 시점을 0, 마지막 시점을 3으로 고정하고 중간 시점()을 추정합니다. 만약 추정된 값이 1.5, 2.5 등으로 나온다면, 성장이 특정 시기에 더 가속화되었음을 알 수 있습니다.

# 잠재 기저 모델 정의

latent_basis_model <- '

# 절편(i) 정의

i =~ 1*Grade1 + 1*Grade2 + 1*Grade3 + 1*Grade4

# 잠재 기저(s) 정의: 첫 시점 0, 끝 시점 3 고정. 중간은 라벨(L2, L3)을 붙여 추정

s =~ 0*Grade1 + L2*Grade2 + L3*Grade3 + 3*Grade4

# i와 s의 평균 및 분산/공분산 추정 (growth 함수가 자동 수행)

'

# 모델 실행

fit_basis <- growth(latent_basis_model, data = vocab_data)

# 결과 보고

summary(fit_basis, fit.measure = TRUE, standardized = TRUE)6. 결측치와 시간 지표의 유연성

실제 연구에서는 학생들이 전학을 가거나 특정 검사를 빠뜨리는 경우가 흔합니다.

- 결측치 처리: SEM 프레임워크는 완전정보 최대우도법(FIML)을 사용하여 결측치가 있는 데이터를 효과적으로 처리합니다. 이는 데이터가 누락된 학생을 제외하지 않고, 남아있는 정보를 모두 사용하여 추정치를 얻는 방식입니다.

- 가속 종단 설계(Accelerated Longitudinal Study): 짧은 기간 동안 여러 연령대의 코호트를 관찰하여, 장기적인 발달 과정을 짧은 시간 안에 재구성하는 방식입니다. 예를 들어, 1-2학년 집단과 2-3학년 집단을 동시에 관찰하여 1학년부터 3학년까지의 궤적을 연결할 수 있습니다.

7. 성장에 영향을 미치는 요인 (조건부 모델)

학생들의 성장 궤적을 설명하기 위해 시간-불변 예측 변수(Time-invariant predictors)를 추가할 수 있습니다.

위 식에서 사회경제적 지위(SES)가 기울기()의 유의한 예측 요인이라면, “가정 형편이 좋을수록 어휘력 성장 속도가 더 빠르다”는 결론을 내릴 수 있습니다.

8. 결론 및 향후 전망

잠재곡선 모델은 교육 현장의 복잡한 변화를 포착하는 데 필수적인 도구입니다. 최근에는 다음과 같은 고급 모델로 발전하고 있습니다:

- 동적 SEM(DSEM): 시계열 데이터의 오차 간 자기회귀 효과까지 고려합니다.

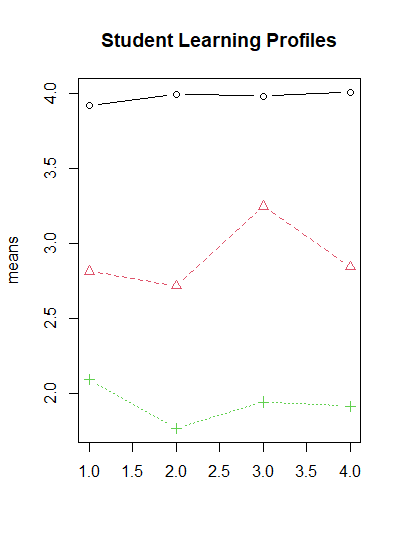

- 성장 혼합 모델(GMM): 서로 다른 성장 궤적을 가진 잠재 집단(예: 상위권, 정체권, 하락권)을 찾아냅니다.

- 잠재 차이 점수 모델(LDS): 시점 간 변화량 자체의 역동성을 분석합니다.

이 도구들을 통해 여러분의 데이터 속에 숨겨진 변화의 이야기를 명확하게 들려주시길 바랍니다.

참고문헌

- Bell, R. Q. (1953). Convergence: An accelerated longitudinal approach. Child Development, 24(3/4), 145–152.

- Bell, R. Q. (1954). An experimental test of the accelerated longitudinal approach. Child Development, 25(4), 281–286.

- Grimm, K. J., Ram, N., & Estabrook, R. (2017). Growth modeling: Structural equation and multilevel modeling approaches. Guilford Press.

- McArdle, J. J. (1988). Dynamic but structural equation modeling of repeated measures data. In J. R. Nesselroade & R. B. Cattell (Eds.), Handbook of multivariate experimental psychology (pp. 561–614). Springer.

- Meredith, W., & Tisak, J. (1990). Latent curve analysis. Psychometrika, 55(1), 107–122.

- Muthén, B., & Shedden, K. (1999). Finite mixture modeling with mixture outcomes using the EM algorithm. Biometrics, 55(2), 463–469.

- Wishart, J. (1938). Growth-rate determinations in nutrition studies with the bacon pig, and their analysis. Biometrika, 30(1/2), 16–28.