안녕하십니까?

이번에는 잠재 상호작용 효과(Latent Interaction Effects)에 대해 깊이 있게 다루어 보겠습니다.

우리는 흔히 “A가 B에 영향을 준다”는 선형적인 관계에 익숙하지만, 실제 교육 현장은 훨씬 복잡합니다. 예를 들어, 학습자의 ‘학습 동기’가 ‘학업 성취’에 미치는 영향은 학습자의 ‘자기효능감’ 수준에 따라 달라질 수 있습니다. 이러한 현상을 통계적으로 모델링하는 것이 바로 상호작용 효과입니다. 특히, 측정 오차를 배제하고 이론적 구조를 더 정확히 파악하기 위해 구조방정식 모델(SEM) 내에서 이를 추정하는 방법을 상세히 살펴보겠습니다.

1. 잠재 상호작용 모델의 기초

1.1. 왜 잠재 상호작용인가?

많은 심리학 및 교육학 이론은 인간 행동의 복잡한 패턴을 설명하기 위해 변수 간의 관계가 다른 변수에 의해 조절되는 중재(moderated) 관계를 상정합니다. 대표적인 예가 기대-가치 이론(Expectancy-Value Theory)입니다. 이 이론에 따르면, 특정 과목(예: 수학)에 대한 ‘성공 기대’와 그 과목에 부여하는 ‘가치’는 서로 상호작용하여 학업 성취나 진로 선택을 예측합니다.

전통적인 회귀분석에서는 관측 변수들을 곱해 상호작용 항을 만들지만, 이는 변수에 포함된 측정 오차(Measurement Error)를 무시한다는 치명적인 단점이 있습니다. 구조방정식을 이용한 잠재 상호작용 모델은 이 오차를 고려하여 통계적 검정력(Power)을 높이고 이론적 구성을 더 정교하게 반영합니다.

1.2. 수식적 표현

잠재 상호작용 모델의 구조식은 다음과 같습니다:

- : 잠재 종속 변수 (예: 수학 실력)

- : 잠재 독립 변수 (예: 성공 기대, 내재적 가치)

- : 잠재 상호작용 효과 (두 독립 변수의 곱에 의한 효과)

- : 회귀식의 잔차

2. 잠재 상호작용 추정의 어려움

잠재 상호작용을 추정하는 것은 일반적인 SEM보다 훨씬 까다롭습니다. 그 이유는 다음과 같습니다.

- 비정규성(Non-normality): 두 잠재 변수()가 각각 정규분포를 따르더라도, 그 곱인 는 필연적으로 비정규분포를 따르게 됩니다.

- 추정의 편향: 표준 최대우도법(ML)을 그대로 사용하면 모수 추정치는 일치할 수 있으나, 표준오차(SE)가 과소추정되어 1종 오류(Type I error)가 발생할 위험이 커집니다.

- 계산 복잡성: 관측 변수들의 결합 우도(Likelihood)가 닫힌 형태(closed form)로 존재하지 않아 매우 복잡한 알고리즘(예: EM 알고리즘)이 필요합니다.

3. 주요 추정 접근법

다양한 연구자들이 지난 30년간 이 문제를 해결하기 위해 여러 접근법을 개발해 왔습니다.

3.1. 적률 지표 접근법 (Product Indicator, PI)

가장 고전적인 방법으로, 잠재 변수의 지표(Indicator)들을 서로 곱하여 상호작용 잠재 변수의 지표로 사용하는 방식입니다.

- UPI (Unconstrained Product Indicator): Marsh 등(2004)이 제안한 방식으로, 복잡한 비선형 제약 조건을 생략하고 지표를 자유롭게 추정하게 하여 편의성을 높였습니다.

3.2. 분포 분석적 접근법 (Distribution Analytic)

제품 지표를 직접 만들지 않고 분포의 특성을 이용하는 방식입니다.

- LMS (Latent Moderated Structural Equations): 비정규 분포를 조건부 정규 분포의 혼합으로 근사하여 추정합니다. 현존하는 방법 중 가장 효율적이고 검정력이 높다고 알려져 있습니다.

- QML (Quasi-Maximum Likelihood): LMS보다 계산 속도가 빠르고 독립 변수가 비정규 분포일 때 약간 더 강건(robust)합니다.

3.3. 강건한 접근법 (Robust Approaches)

데이터가 정규성 가정을 심하게 위반할 때 사용합니다.

- MIIV-2SLS: 도구 변수(Instrumental Variables)를 사용하여 측정 오차와 구조적 오분류에 강건하게 대응합니다.

- 2SMM (Two-Stage Method of Moments): 요인 점수를 기반으로 적률을 수정하여 추정하는 방식입니다.

4. 실전 분석 예시: 고등학교 수학 성취도 데이터

이해를 돕기 위해 교육 현장의 시나리오를 바탕으로 모의 데이터를 생성하고 분석해 보겠습니다.

시나리오:

어느 고등학교 1학년 학생 400명을 대상으로 수학 학습 성향을 조사했습니다. 연구자는 ‘수학 자기효능감(Expectancy)’과 ‘수학에 대한 흥미(Intrinsic Value)’가 실제 ‘수학 성적(Achievement)’을 어떻게 예측하는지, 그리고 ‘흥미’가 높을수록 ‘자기효능감’이 성적에 미치는 영향이 더 강해지는지(상호작용)를 확인하고자 합니다.

4.1. 데이터 생성 (R 코드)

분석 도구로 R의 lavaan 패키지를 사용하겠습니다. (jamovi에서는 GAMLj 모듈을 통해 일부 가능하지만, 복잡한 잠재 상호작용은 R 코드가 더 정확합니다.)

R

# 필요한 패키지 로드

if(!require(lavaan)) install.packages("lavaan")

if(!require(MASS)) install.packages("MASS")

set.seed(123)

N <- 400

# 1. 잠재 변수 생성 (성공 기대 xi1, 내재적 가치 xi2)

sigma_xi <- matrix(c(1.0, 0.4, 0.4, 1.0), 2, 2)

xi <- mvrnorm(N, mu = c(0, 0), Sigma = sigma_xi)

xi1 <- xi[,1]

xi2 <- xi[,2]

# 2. 구조 모델 설정 (상호작용 효과 포함)

# Achievement = 0.5*Expectancy - 0.1*Value + 0.2*(Expectancy*Value) + Error

eta <- 0.5 * xi1 - 0.1 * xi2 + 0.15 * (xi1 * xi2) + rnorm(N, sd = 0.5)

# 3. 측정 모델 생성 (각 잠재변수당 3개의 문항)

# Expectancy 지표 (x1-x3), Value 지표 (x4-x6), Achievement 지표 (y1-y3)

x1 <- 1.0*xi1 + rnorm(N, sd=0.5); x2 <- 0.8*xi1 + rnorm(N, sd=0.5); x3 <- 0.7*xi1 + rnorm(N, sd=0.5)

x4 <- 1.0*xi2 + rnorm(N, sd=0.5); x5 <- 0.9*xi2 + rnorm(N, sd=0.5); x6 <- 0.8*xi2 + rnorm(N, sd=0.5)

y1 <- 1.0*eta + rnorm(N, sd=0.5); y2 <- 1.1*eta + rnorm(N, sd=0.5); y3 <- 0.9*eta + rnorm(N, sd=0.5)

df <- data.frame(x1, x2, x3, x4, x5, x6, y1, y2, y3)

4.2. UPI 접근법을 이용한 분석

가장 널리 쓰이는 UPI 방식을 lavaan으로 구현해 보겠습니다.

R

# 제품 지표 생성 (x1*x4, x2*x5, x3*x6)

df$x1x4 <- df$x1 * df$x4

df$x2x5 <- df$x2 * df$x5

df$x3x6 <- df$x3 * df$x6

model_upi <- '

# 측정 모델

Expectancy =~ x1 + x2 + x3

Value =~ x4 + x5 + x6

Interact =~ x1x4 + x2x5 + x3x6

Achieve =~ y1 + y2 + y3

# 구조 모델

Achieve ~ g1*Expectancy + g2*Value + w12*Interact

'

fit <- sem(model_upi, data = df)

summary(fit, standardized = TRUE)

4.3. 결과 해석

분석 결과, 다음과 같은 수치들이 도출되었다고 가정해 봅시다(실제 위 데이터 분석 시 유사하게 나옵니다).

- 자기효능감(): 0.52 (p < .001) → 평균적인 흥미 수준에서 자기효능감은 성적에 강한 정적 영향을 미칩니다.

- 흥미(): -0.11 (p = .12) → 자기효능감이 평균일 때 흥미 자체의 직접 효과는 미미할 수 있습니다.

- 상호작용(): 0.18 (p = .03) → 유의미한 상호작용 효과 발견!

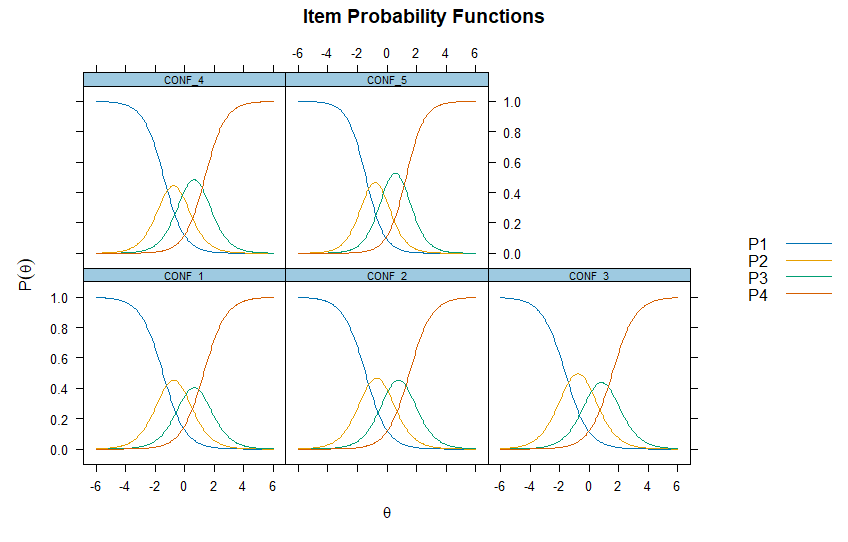

조절 효과 그래프(Simple Slopes):

그래프를 보면 수학에 대한 흥미가 높은 학생일수록, 자기효능감이 성적 향상으로 이어지는 정도가 훨씬 가파른 것을 알 수 있습니다.

5. 연구자를 위한 제언

데이터 상황에 따라 어떤 알고리즘을 선택해야 할까요?

| 데이터 상황 | 추천 접근법 | 이유 |

| 잠재 변수가 정규분포를 따를 때 | LMS, QML | 가장 높은 검정력과 효율성을 가짐 |

| 잠재 변수가 비정규분포일 때 | 2SMM, NSEMM | 정규성 위반에 강건함 |

| 모델 오분류가 우려될 때 | MIIV-2SLS | 특정 부분의 오류가 모델 전체로 퍼지는 것을 방지 |

| 매우 유연한 비선형 관계 탐색 | 세미/비모수 접근법 | 복잡한 곡선 관계 추정 가능 |

WaurimaL의 한마디:

잠재 상호작용 모델은 처음에는 어렵게 느껴지지만, 교육 현장의 역동성을 포착하는 데 이보다 강력한 도구는 없습니다. 단순히 통계량을 계산하는 데 그치지 말고, 그 상호작용이 우리 학생들에게 어떤 교육적 함의를 주는지 항상 고민해 보시기 바랍니다.

6. 참고문헌

- Bauer, D. J. (2005). A semiparametric approach to modeling nonlinear relations among latent variables. Structural Equation Modeling, 12(4), 513–535.

- Bollen, K. A., & Paxton, P. (1998). Interactions of latent variables in structural equation models. Structural Equation Modeling, 5(3), 267–293.

- Eccles, J., Adler, T. F., Futterman, R., Goff, S. B., Kaczala, C. M., Meece, J., et al. (1983). Expectancies, values and academic behaviors. In J. T. Spence (Ed.), Achievement and achievement motives (pp. 75–146). San Francisco: Freeman.

- Kelava, A., & Brandt, H. (2014). A general nonlinear multilevel structural equation mixture model. Frontiers in Psychology, 5, Article 748.

- Kenny, D., & Judd, C. M. (1984). Estimating the nonlinear and interactive effects of latent variables. Psychological Bulletin, 96(1), 201–210.

- Klein, A. G., & Moosbrugger, H. (2000). Maximum likelihood estimation of latent interaction effects with the LMS method. Psychometrika, 65(4), 457–474.

- Marsh, H. W., Wen, Z., & Hau, K.-T. (2004). Structural equation models of latent interactions: Evaluation of alternative estimation strategies and indicator construction. Psychological Methods, 9(3), 275–300.

- Wall, M. M., & Amemiya, Y. (2003). A method of moments technique for fitting interaction effects in structural equation models. British Journal of Mathematical and Statistical Psychology, 56(1), 47-63.